LMArena,前身为 Chatbot Arena是由加州大学伯克利分校 LMSYS 团队发起、如今独立运营的开源 AI 模型评测平台。

该平台是一款众包式大语言模型(LLM)盲测竞技场,它通过真实用户匿名投票的方式,让各种 AI 模型(如 GPT-4o、Claude、Gemini、Llama 等)进行一对一“对决”,生成动态排行榜(Leaderboard)。

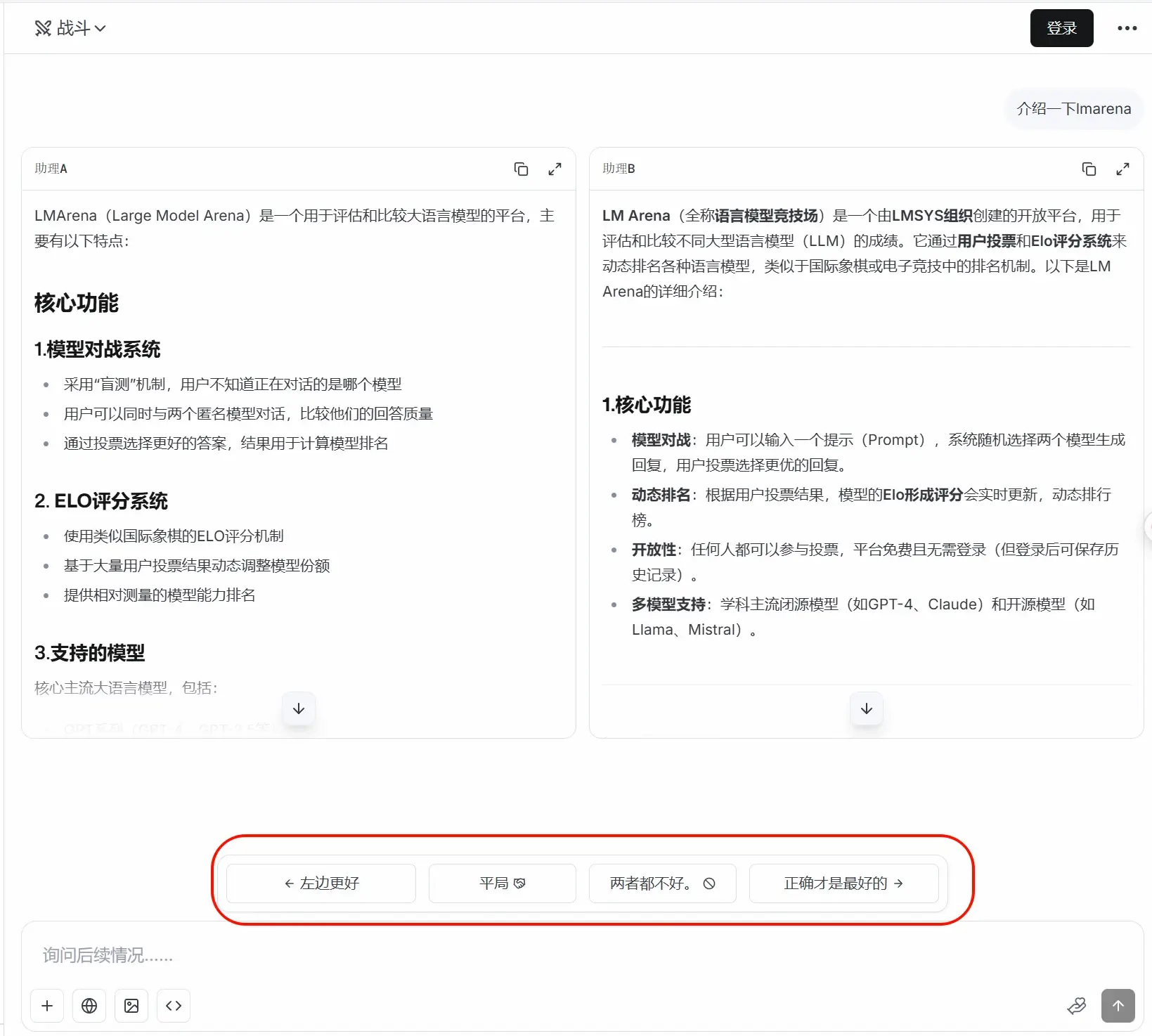

盲测对战(Arena)

用户输入同一提示词,平台随机分配两个匿名模型生成回复,用户投票选出更好的一方,投票后才揭示模型身份。

实时排行榜

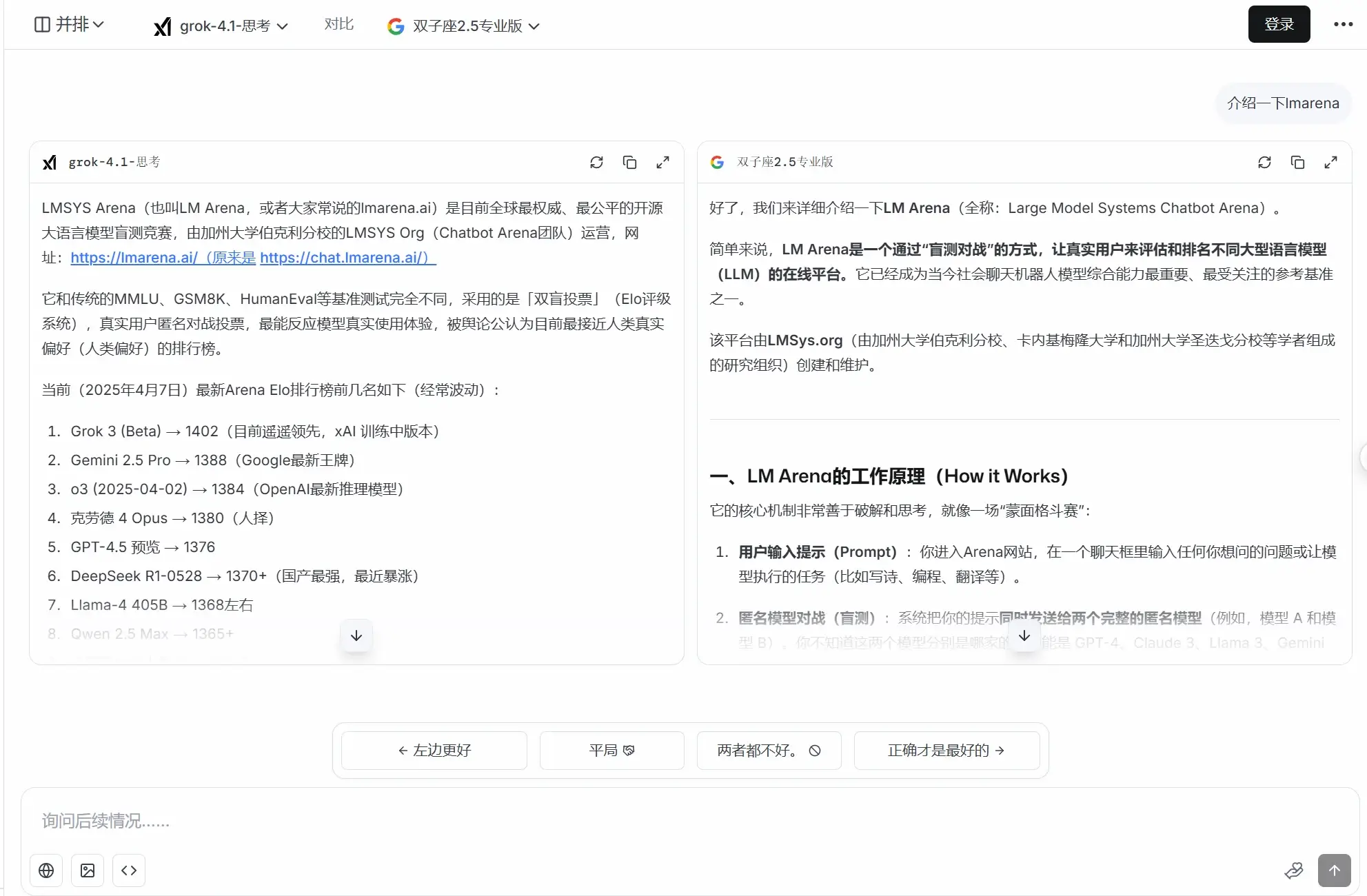

排行榜采用 Elo 评分系统(类似国际象棋排名)计算模型胜率。通过大量用户投票对模型实力进行量化,使排名能够真实反映用户偏好。

从ChatGPT、Claude到谷歌的Gemini系列,几乎所有知名AI模型都在LMArena的排行榜上一较高下,这里也成为了AI开发者、研究人员和爱好者了解最新模型性能的首选平台。

排行榜涵盖了文本生成、图像生成、代码开发、网页开发等多个赛道,用户可以从不同维度了解各模型在不同领域的表现强弱。

目前排名第一的文本生成模型是刚发布的grok – 4.1大模型。

访问与基础操作

首先,在浏览器中访问LMArena.ai官网。平台界面直观,主要功能在首页即可找到。对于新用户,建议从以下步骤开始:

- 选择交互模式:首页主要提供两种模式 – Battle(对战)模式和Direct Chat(直接聊天)模式。对于首次使用的用户,Battle模式更能体现LMArena的核心特色。

- Battle模式体验:选择Battle模式后,系统会随机分配两个匿名模型。用户输入问题后,两个模型会同时生成回答,用户需要根据回答质量投票选择更优的一方。这个过程完全匿名,直到投票后,用户才能看到所使用模型的名称(可选)。

- Direct Chat模式使用:如果需要使用特定模型完成特定任务,如生成AI公仔,则应选择Direct Chat模式,然后从模型列表中选择所需的模型,如Gemini-2.5-Flash。

数据统计

相关导航

开源大模型的综合能力排行榜

AI Ping

AI Ping 是一款由清华系团队打造的免费大模型服务性能评测平台,通过7x24小时实时监控与多维度对比,为开发者提供客观、全面的选型参考,助力AI应用高效稳定落地。

Artificial Analysis

独立 AI 基准测试与分析平台

GDPval

OpenAI推出的大模型全新评估指标

C-Eval

大语言模型的多层次多学科中文评估套件

PinchBench

专为AI Agent( OpenClaw)开发的基准测试平台

SWE-Bench Pro

一代软件工程 AI 基准测试集。

SEAL LLM 排行榜

多维度模型排名和基准测试

暂无评论...