今天上午deepseek突然官宣:全新系列模型 DeepSeek-V4 的预览版本上线并同步开源。距离上次大版本更新已经过去了 15 个月,期间行业里各家都在疯狂迭代,大家等 V4 等得花都要谢了。

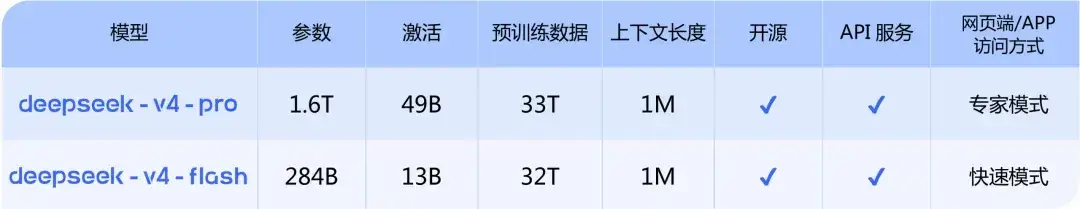

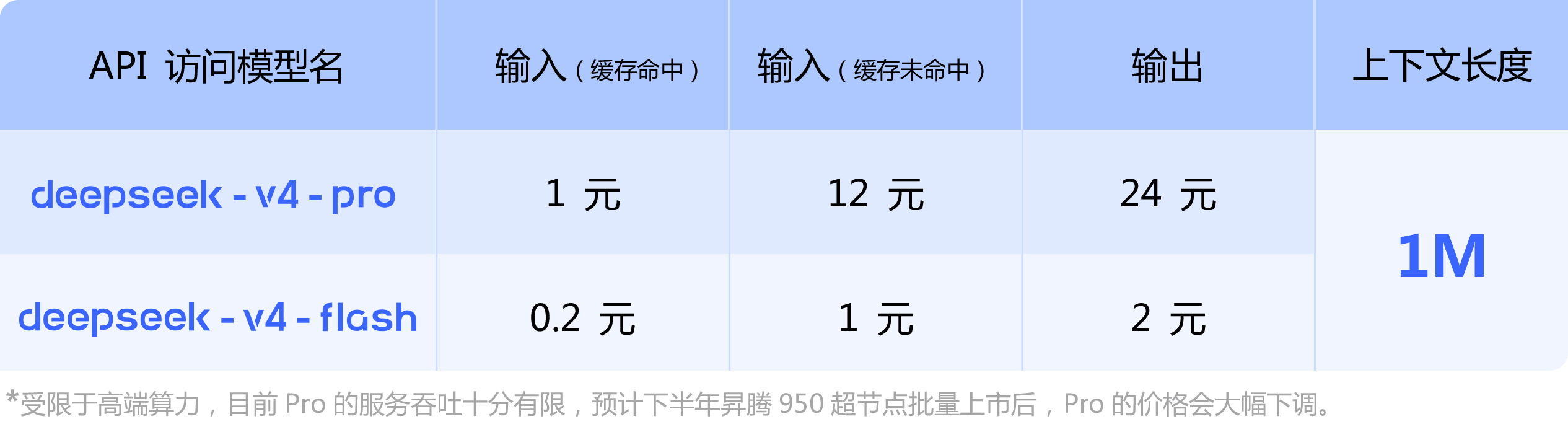

官宣后,官网页版和APP直接就可以使用,API 也同步更新了。这次一共发了两个版本:DeepSeek-V4-Pro 和 DeepSeek-V4-Flash,大家在使用的时候分别对应的是官网的专家模式和快速模式。

核心看点

1,这两款大模型都标配 100 万 Token 上下文。100 万 Token 按中文文本算,差不多能一口吞下 75 万字,也就是《三体》三部曲的全部体量。

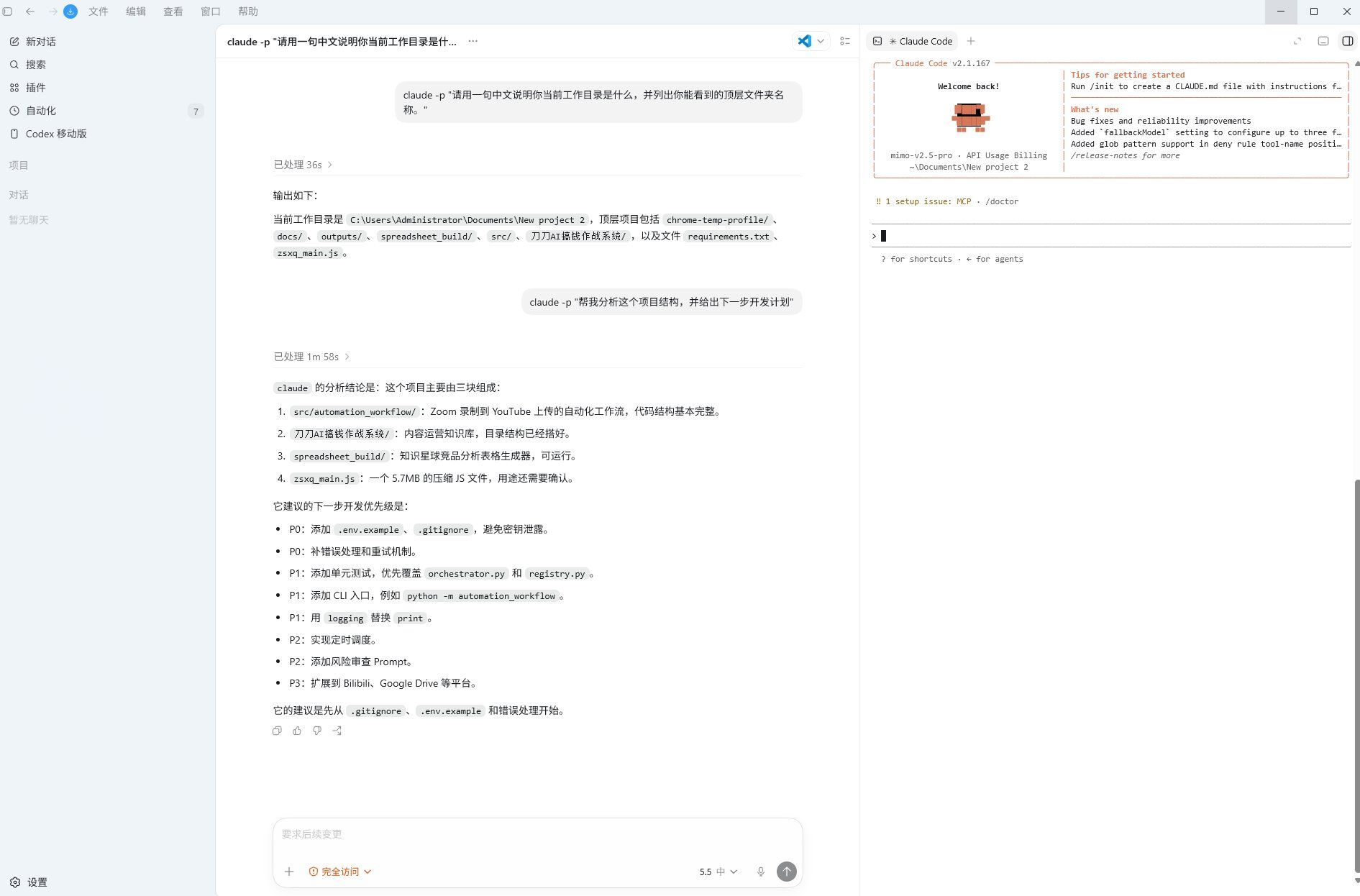

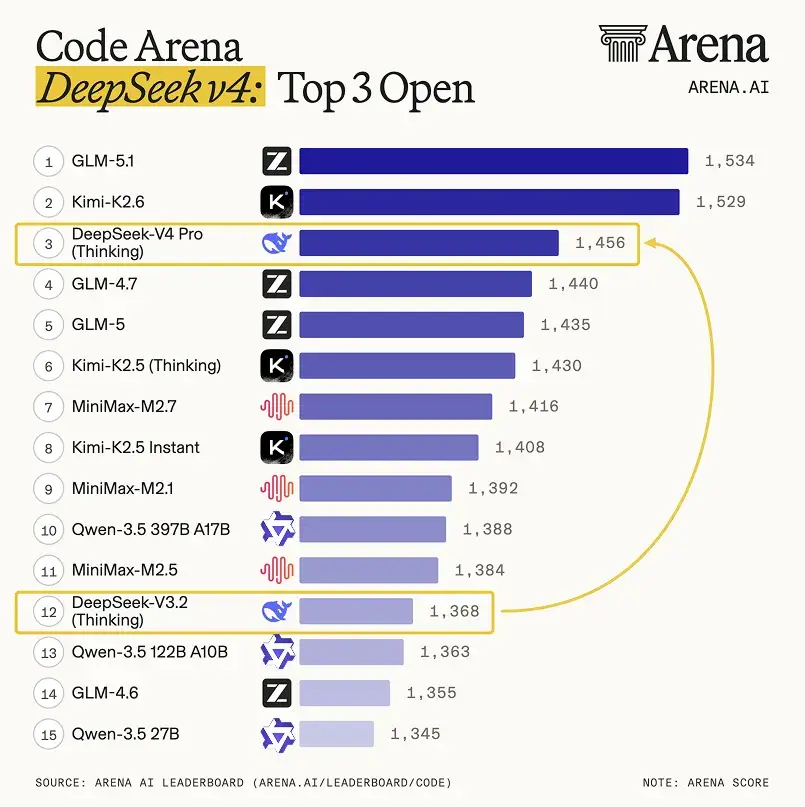

2,V4-Pro 的Agent 能力大幅跃升,在 Agentic Coding 评测中直接拿下开源模型最佳成绩。更擅长拆解任务、调用工具、写代码、改代码、跑流程。

据说内部员工已经把 V4 当作日常主力编程模型。在代码能力方面V4-Pro在 Arena 的评分直接从V3.2的第12名直接跳到了第三名。

3,架构创新,长文本不再“吃显存”。这次 V4 的核心是全新混合注意力架构,在 100 万 Token 上下文下,V4-Pro 单 Token 推理的算力消耗只有 V3.2 的 27%,KV 缓存占用只有 10%。这也从侧边说明 V4 大模型的成本将会极大的下调。

4,熟悉的“价格屠夫”又回来了。每百万输出 Token 最低仅需2元,对比OpenAI 刚上线了 GPT-5.5,每百万输出 Token 定价 30 美元。这差价有将近 100 倍。

我们在官方的介绍页面有一行小字:Pro 版本目前受限于高端算力供给,并发吞吐量有限。在下半年昇腾 950 超节点批量上市后,Pro 的价格还会大幅下调。

使用渠道

官网地址:https://chat.deepseek.com/和应用商店搜“DeepSeek”下载官方 App。其中专家模式为V4 Pro 模型,快速模式为V4-Flash 模型。

相关文章