MiniMax M2.7上线OrcaRouter,提供兼容OpenAI的API

国产大模型公司MiniMax在官方推特宣布,其迭代速度快、在工程代码等领域表现突出的模型M2.7,已正式上线OrcaRouter平台。这意味着开发者现在可以通过OrcaRouter提供的单一OpenAI兼容API来访问和使用M2.7模型。

当今最强大的开源模型之一 现在可通过单一 OpenAI 兼容 API 访问。 定价: 输入:0.30美元 / 100万词元 输出:1.20美元 / 100万词元 缓存读取:0.06美元 / 100万词元 缓存写入:$0.375 / 100万次

M2.7是什么来头?

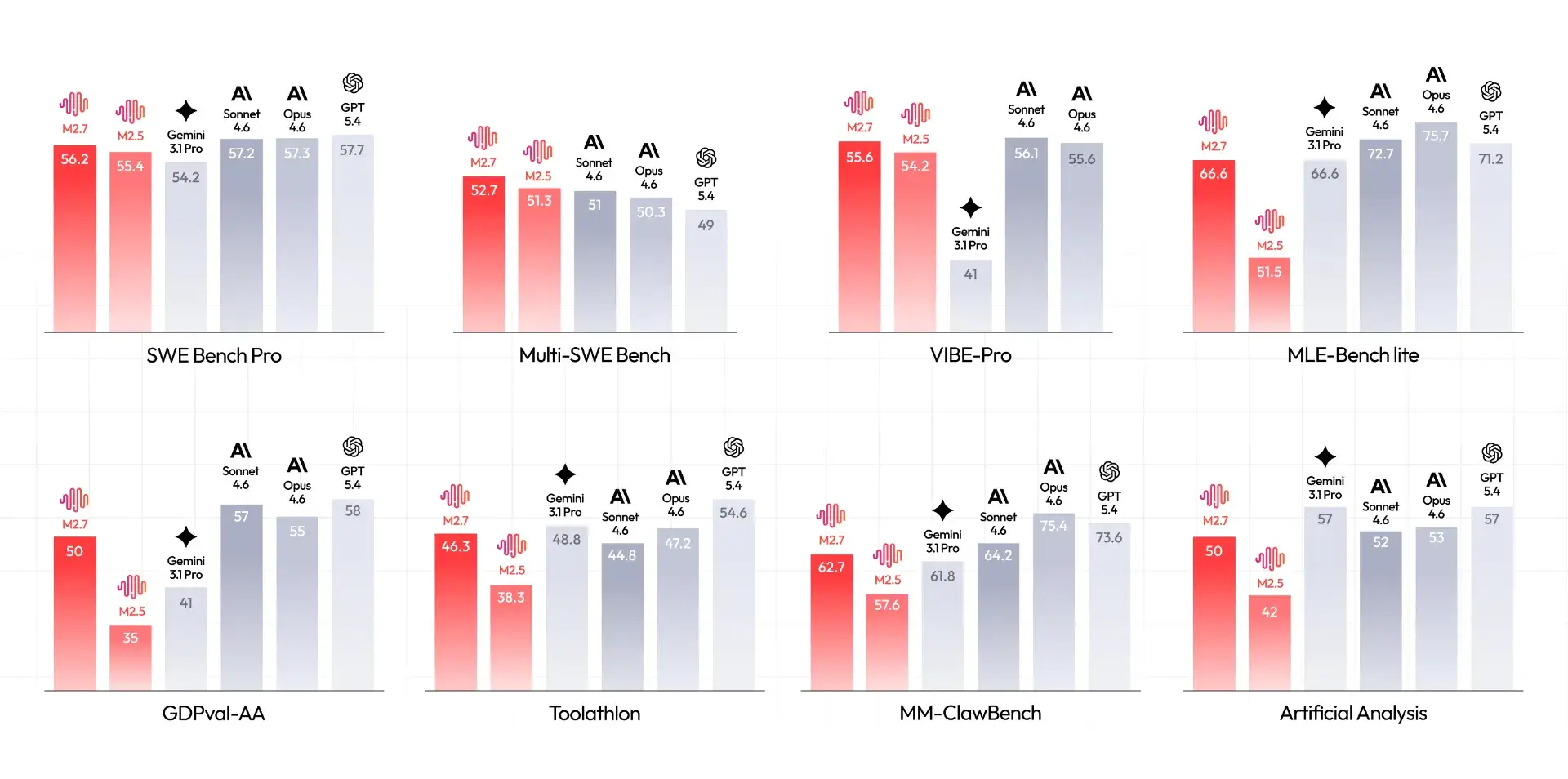

M2.7是MiniMax在2026年3月发布、并于同年4月12日全球开源的模型。它在软件工程基准测试(如SWE-Pro)中得分接近顶尖水平,并在办公文档处理、复杂任务理解上有显著提升。开源后,它已快速完成了与华为昇腾、NVIDIA、Together AI等众多硬件及推理平台的适配。

OrcaRouter的作用是什么?

OrcaRouter可以理解为一个模型聚合平台,它为多种模型提供统一的、标准化的API接口。对于开发者而言,最大的便利在于无需针对每个模型厂商的不同API格式做适配。如果你已经习惯或拥有OpenAI的API调用代码,现在只需更换API端点和密钥,就能尝试M2.7。

怎么用?适合谁?

目前,想要体验的开发者需要前往OrcaRouter平台,在其文档中查找关于M2.7的具体API端点、请求格式以及如何获取API密钥的说明。这对于个人开发者、小型团队,或是已经构建了基于OpenAI接口应用的用户来说,是尝试一个高质量国产模型的最快路径之一。它也适合那些希望对比不同模型(例如在OrcaRouter上切换调用不同模型)进行选型或评估的场景。

需要留意的是,M2.7模型本身已开源,开发者也可以选择自行部署。而通过OrcaRouter调用,具体的调用定价、速率限制以及详细的API文档,均需以其平台官方公布为准。开源模型经第三方平台托管,其服务的稳定性和响应质量可能需要你实际测试后判断。

相关快讯