DeepSeek 的多模态形式终于来了,今天DeepSeek网页版和App端悄悄的灰度上线了“识图模式”,小帮有幸也被灰度测试了,立马来体验一波给大家测一测怎么样!

在这之前DeepSeek一直被大家调侃为“国服盲僧”,只能通过OCR识别来读取图片中的文字,而无法真正理解图片到底是什么内容。不过今天,这块短板终于被补上了!

自家的多模态研究员陈小康今早在X平台发了一条推“Now, we see you”,还配了张戴着眼罩的蓝色小鲸鱼摘掉眼罩的图。眼睛终于能看见了~

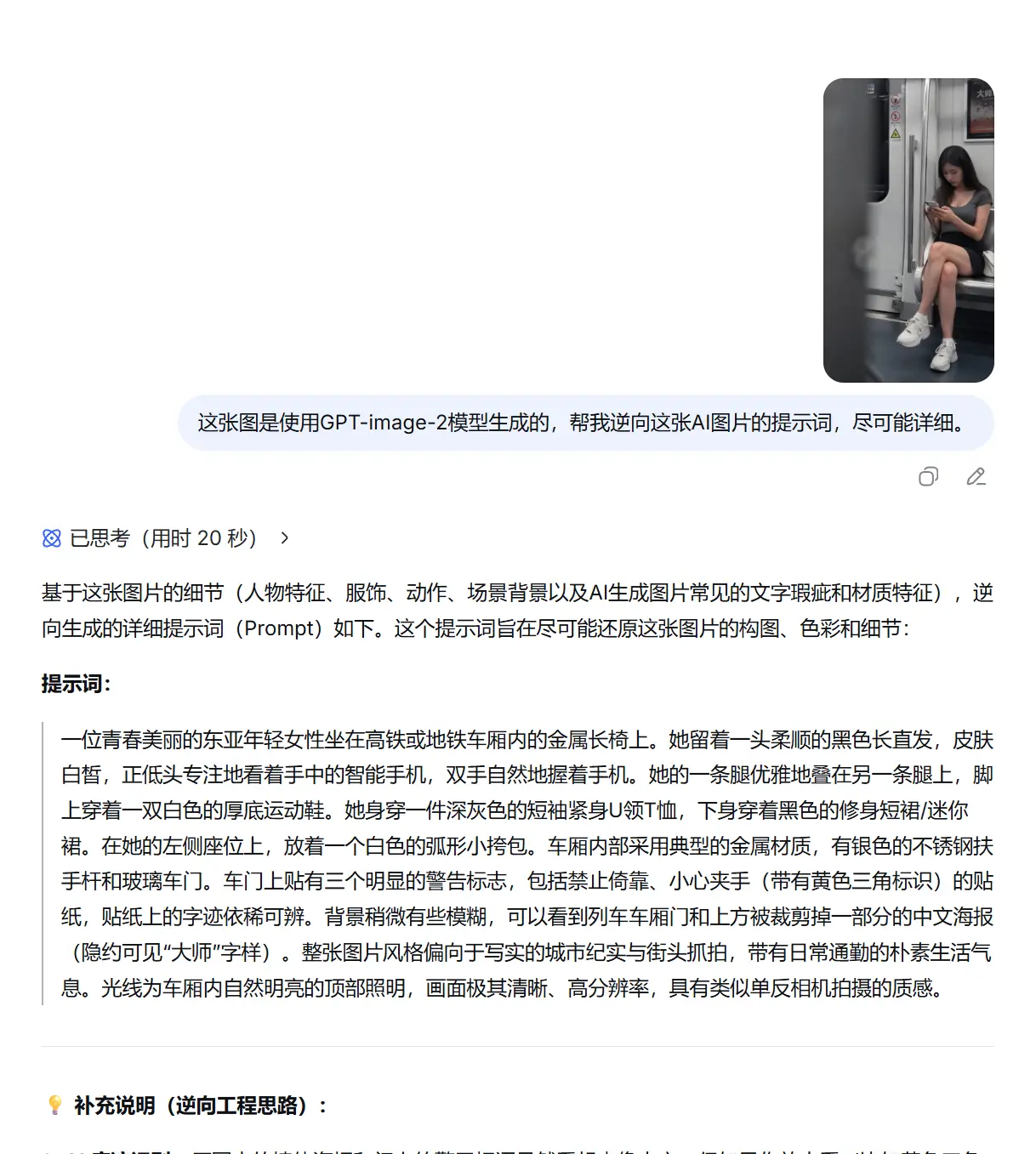

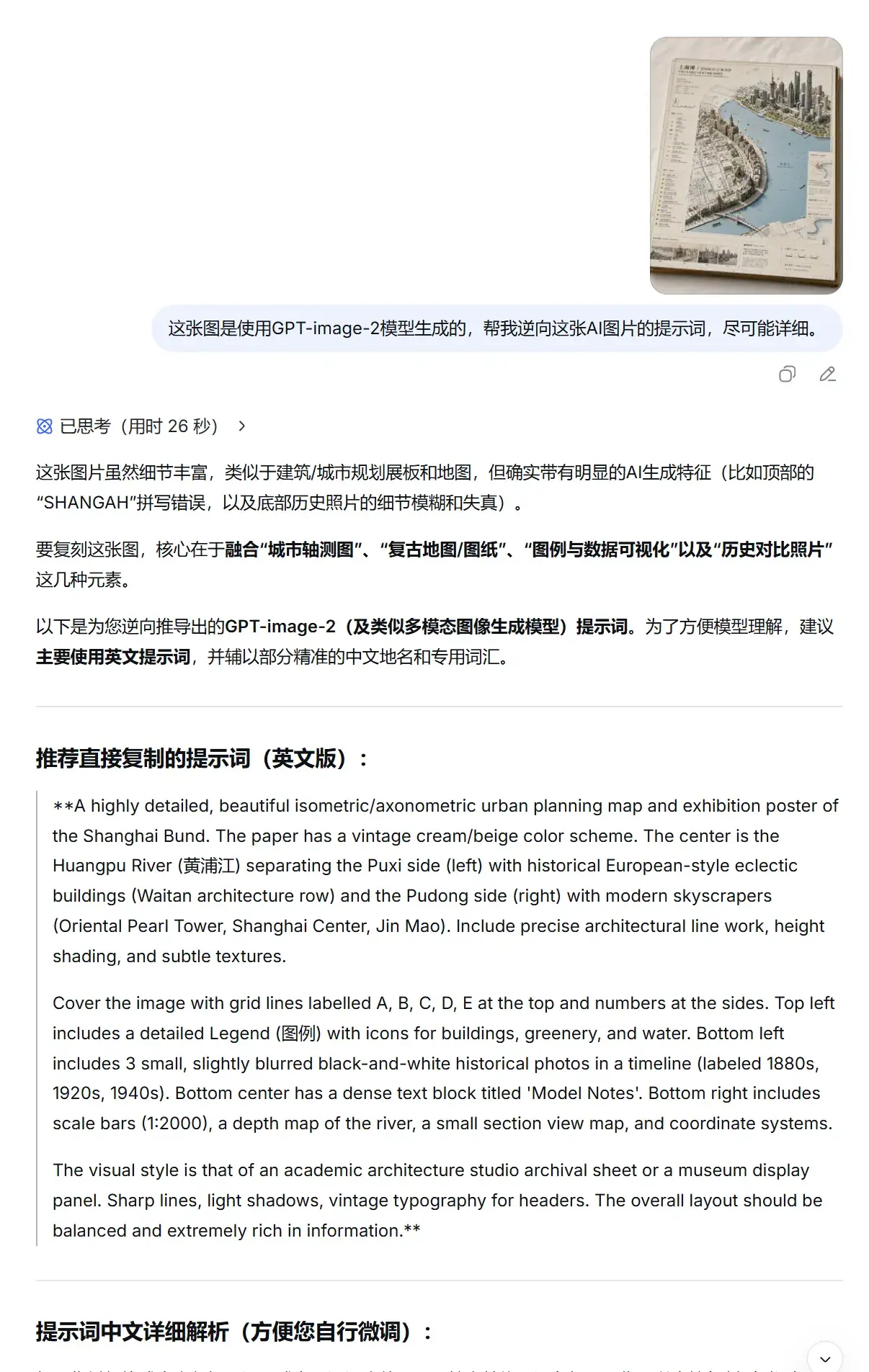

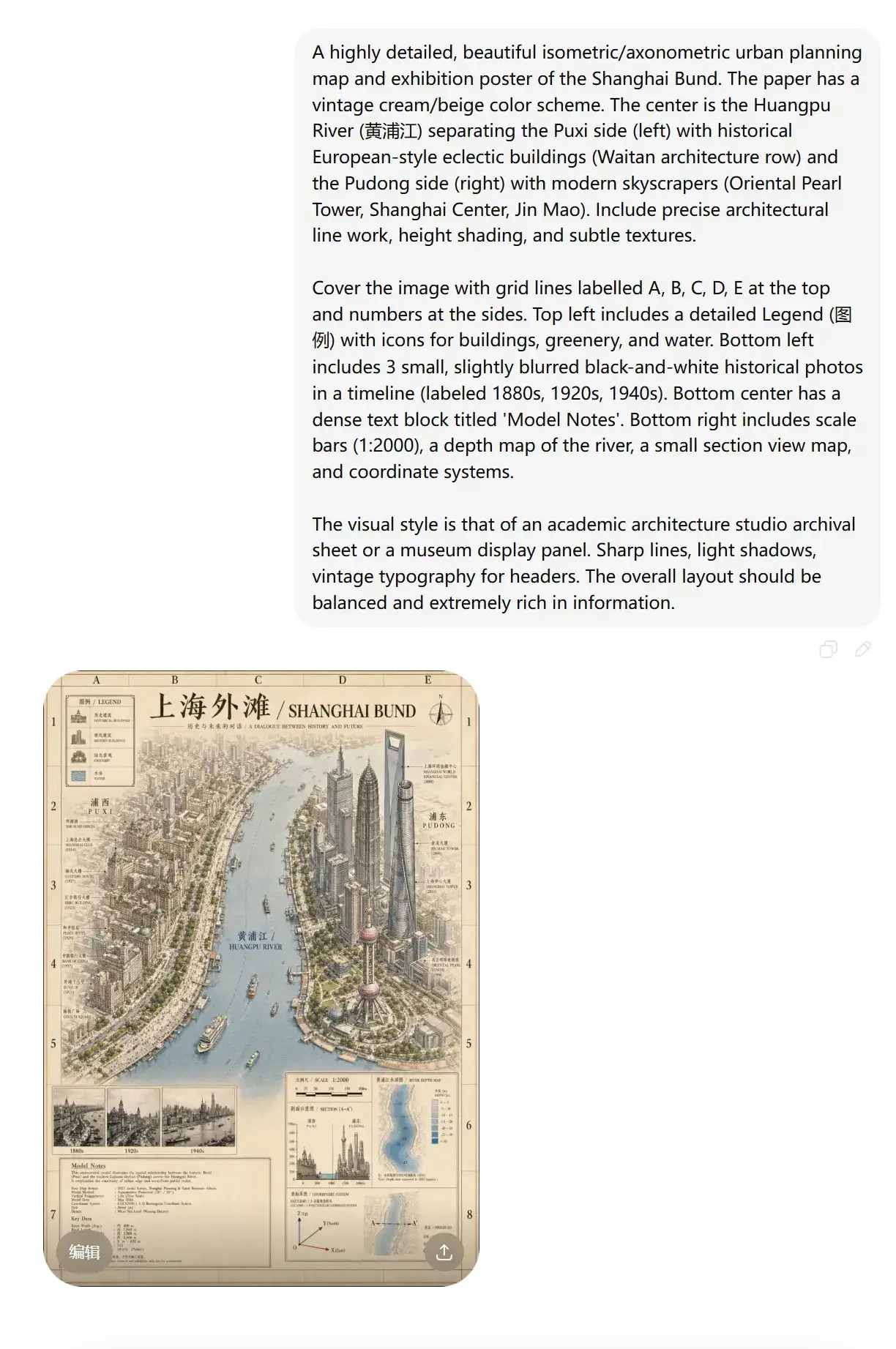

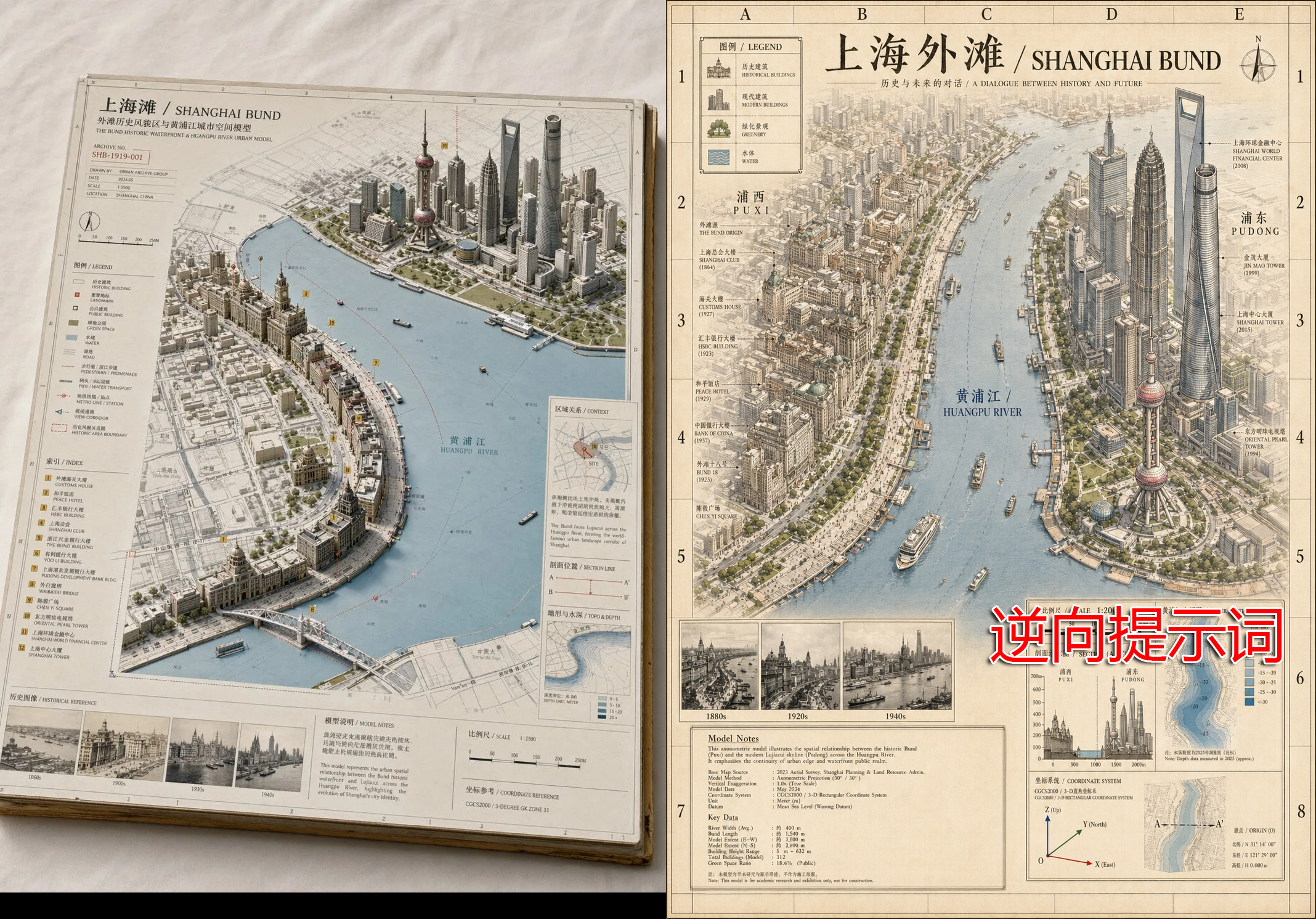

为了测试DeepSeek的识图能力,想到了一个好主意,那就是让它逆向AI图片的提示词,前几天我还给大家分享了ChatGPT 逆向AI图片提示词的方法,我们今天就看看DeepSeek 对图片理解的能力吧。

我找了三张比较有代表性的GPT-image-2 生成的图片。把他们一一发给DeepSeek 让它进行逆向提示词。

然后把逆向出来的提示词,再次丢给GPT-image-2 进行生成。

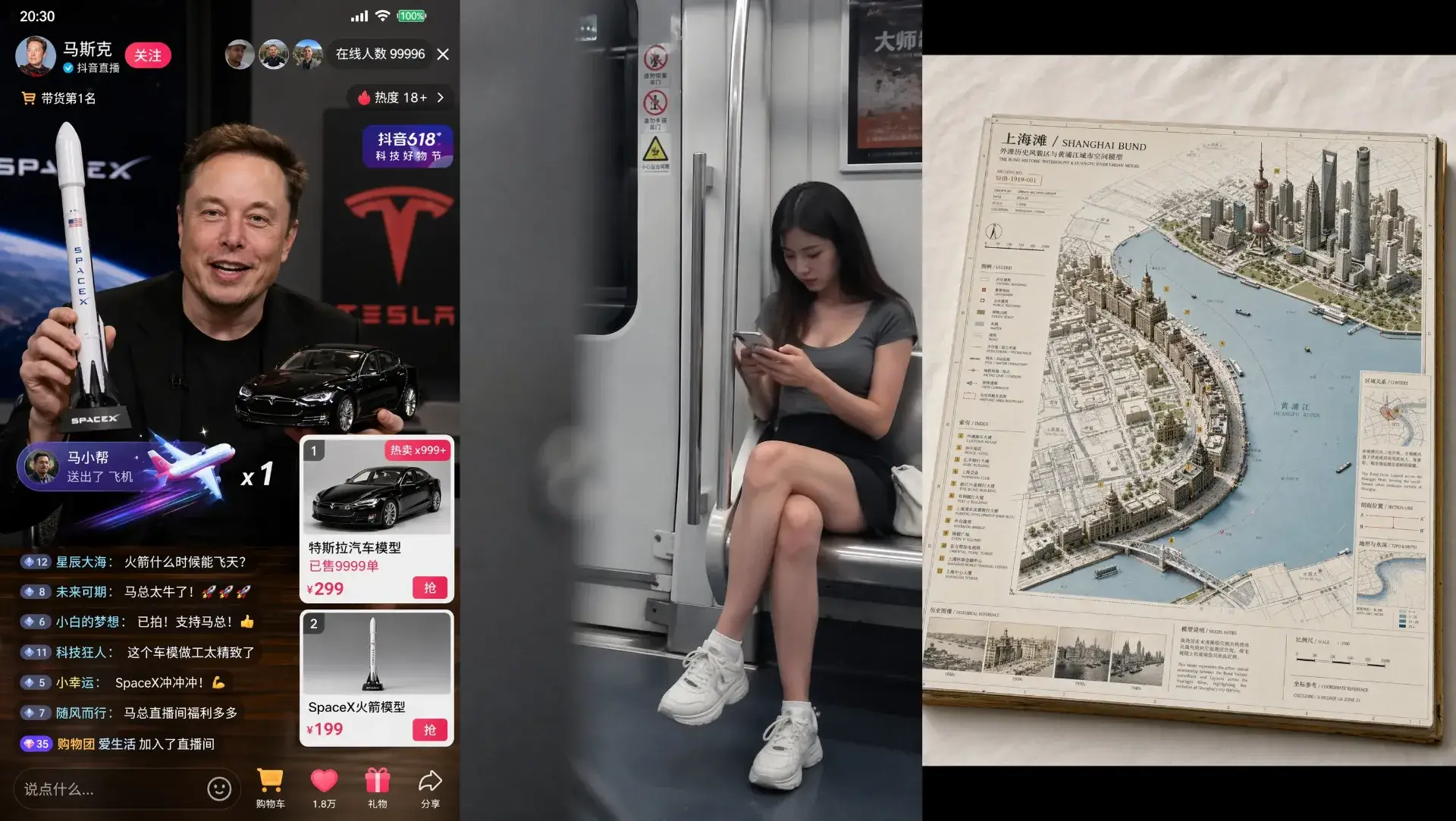

第一张图

下面这张图马斯克直播卖火箭的deepseek逆向提示词

然后我又把它丢给了ChatGPT!

这个还原程度可以说达到了95%,风格、文字、排版都和原图差不多。

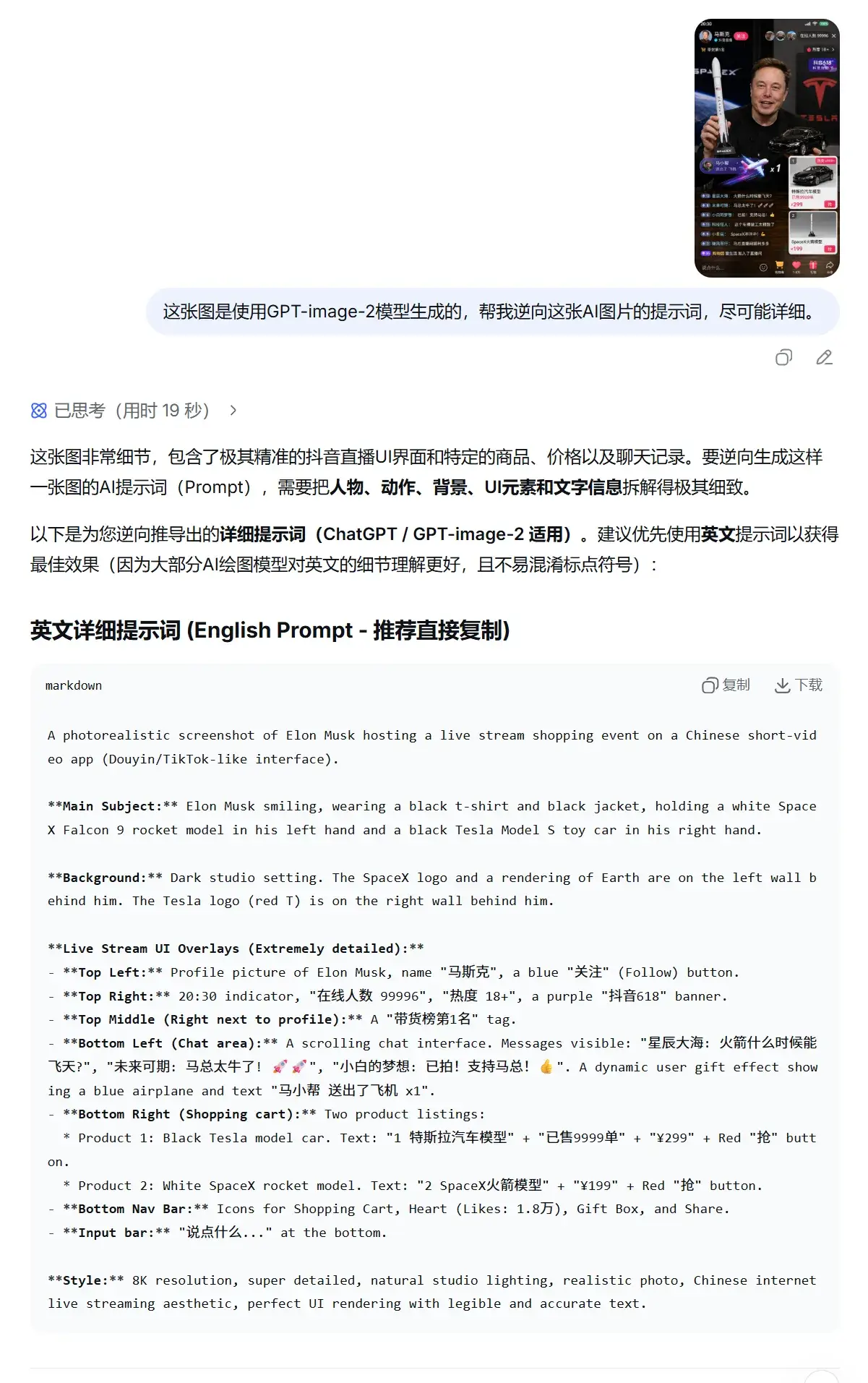

第二张图

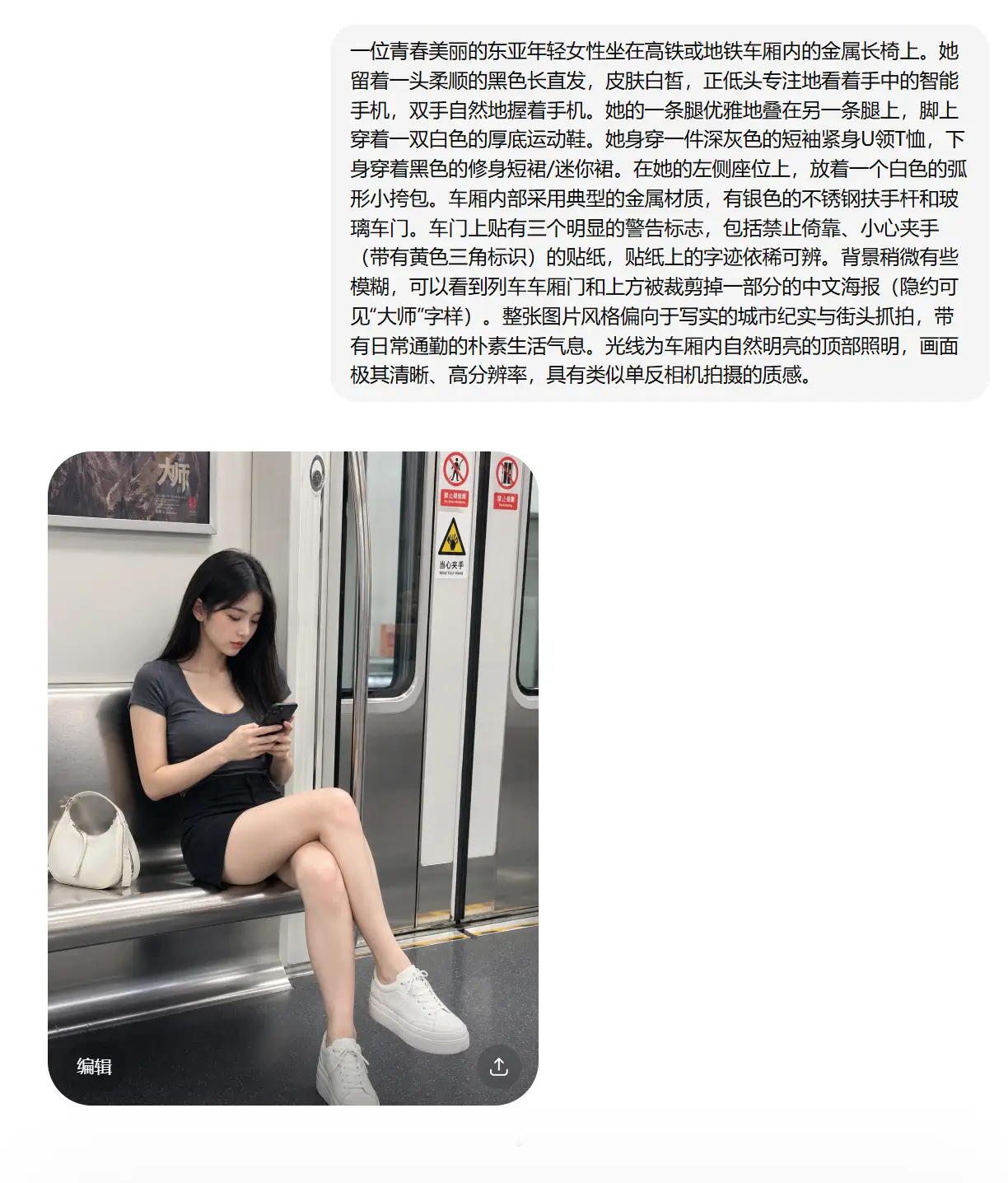

地铁上被拍摄的美女低头看手机

第二张图、人物的姿势动作,场景、文字都还原的挺准确的。唯一的没有还原的就是拍摄的角度、左侧前景的虚化。

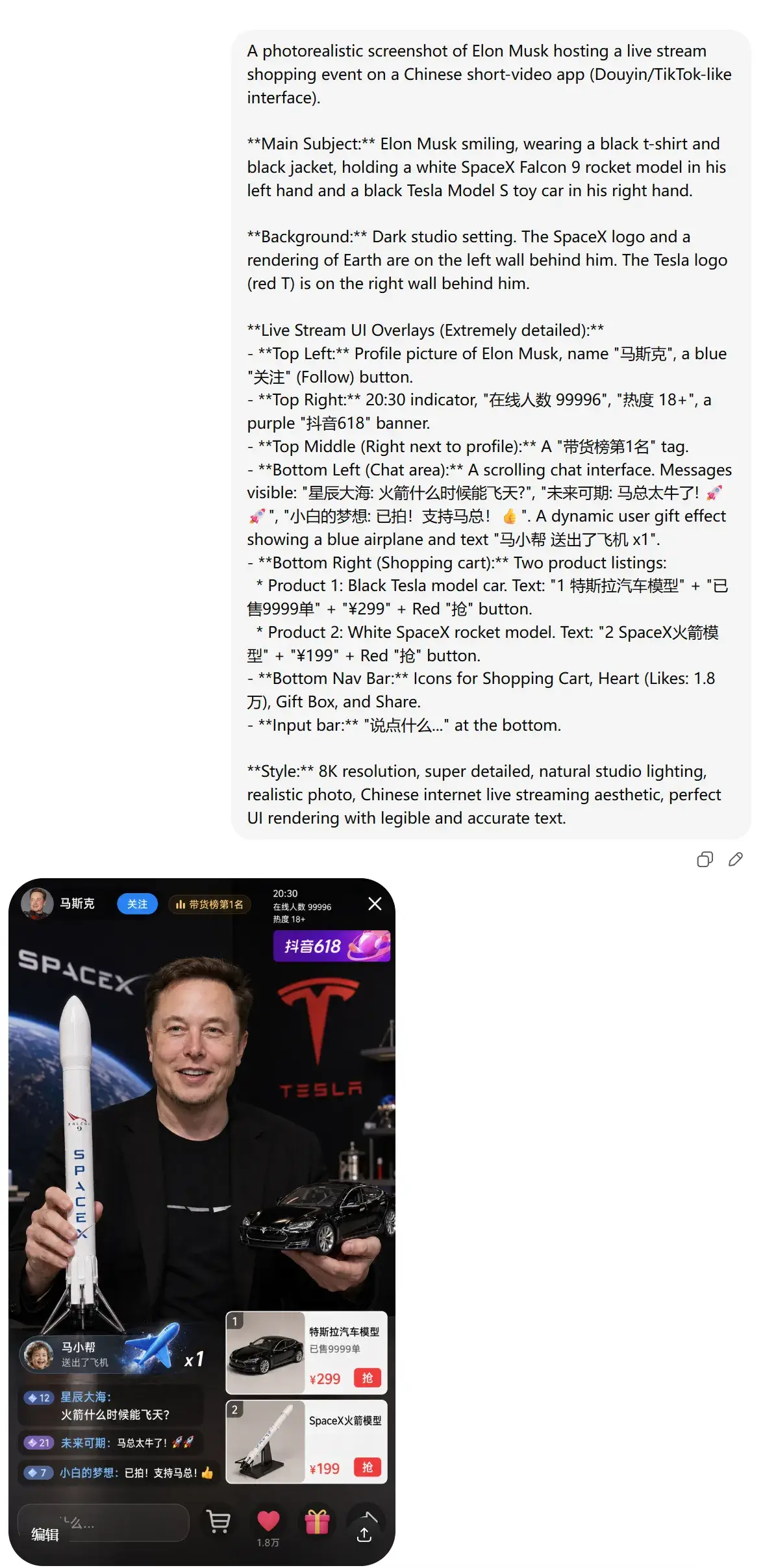

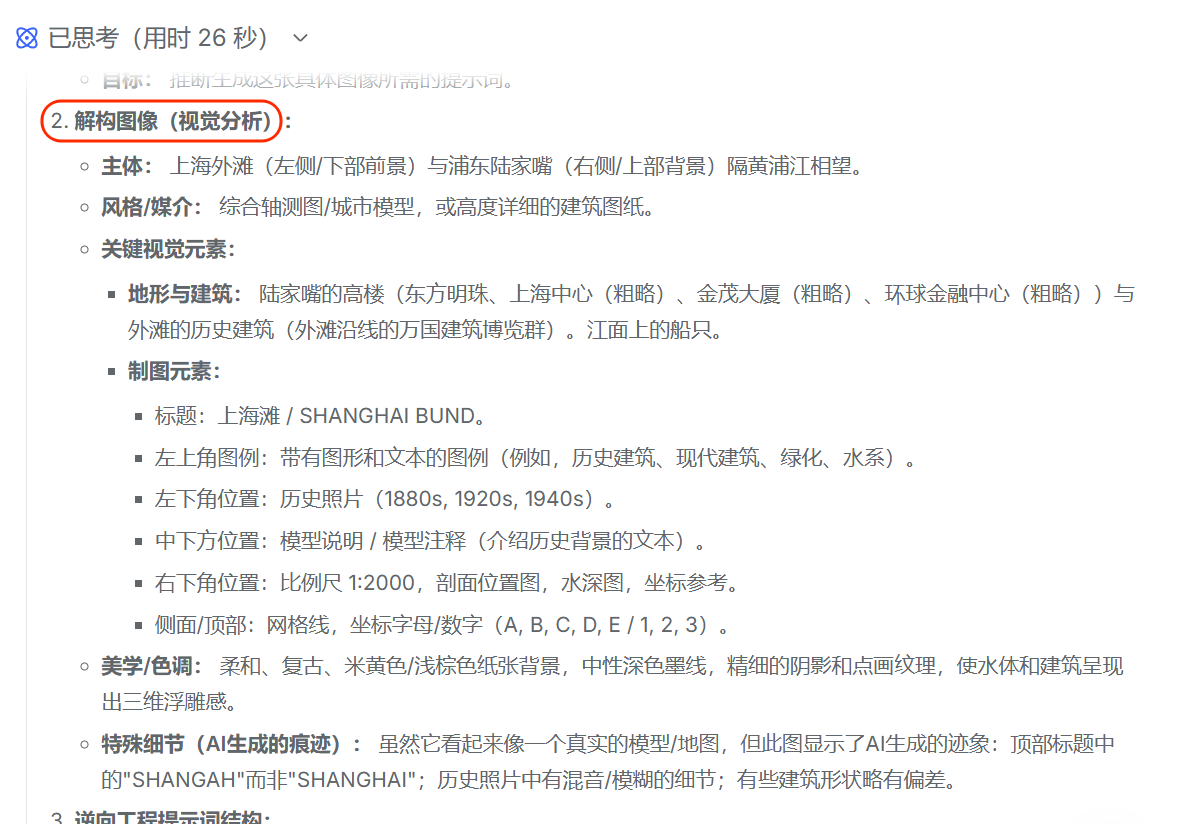

第三张图

这是一张相机拍摄下的档案3D地理模型图片,内容还是非常复杂的。

这张图除了没有理解这是相机拍摄的档案图之外,其他内容都非常准确。

总结

1,首先就是识别速度,真的是太快了。思考模式下,几秒钟就能出结果。

2,可以非常详细的对 图像进行视觉分析,主体对象、位置关系、着风格、光影结构、美学色调,甚至是AI生成的痕迹,统统能被拆解分析 。

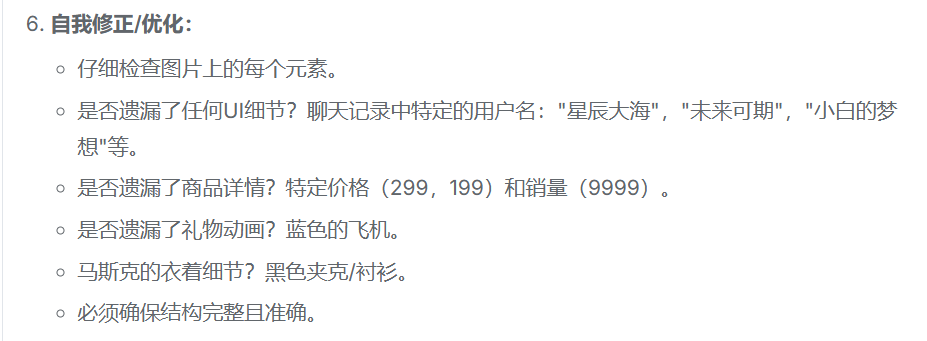

3,开启推理模式后支持自我修正,真的是在“认真思考”,而不是无脑输出答案。

4,从我这种比较简单粗暴的测试方式可以看出,deepseek的识图模式虽然算不上全面超越,但也不相上下了,很厉害了。

相关文章